Umělá inteligence v soudní síni: Kdy je její použití ještě přijatelné?

Rychlý nástup umělé inteligence v různých oblastech

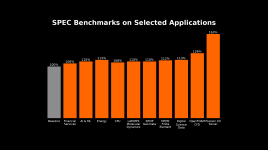

V posledních letech zaznamenáváme obrovský rozmach umělé inteligence ve všech možných oblastech lidského života. AI je používána při analýze dat, zdravotnictví, technologiích, a dokonce i ve finančním sektoru. Její potenciál v oblasti zpracování obrovských množství informací a analýzy složitých dat je nesporný. Nicméně otázkou zůstává, jak spolehlivě lze tyto nástroje využívat ve specifických oblastech, jako je právo a soudnictví.

Jedním z nedávných případů, který vyvolal debatu o etice a spolehlivosti AI, byl soudní spor v New Yorku, kde expert svědek použil nástroj Microsoft Copilot k výpočtu škod ve sporu o nemovitost. Přestože se zdálo, že Copilot může urychlit a zjednodušit složité výpočty, soudce výpočty zpochybnil kvůli nedostatku odborné expertizy svědka a nespolehlivým výsledkům generovaným chatbotem.

Případ s nemovitostí na Bahamách

Kauza se týkala sporu o nemovitost na Bahamách, kterou měla v držení rodina. Syn zesnulého vlastníka tvrdil, že jeho teta, která byla vykonavatelkou závěti, neoprávněně používala nemovitost pro vlastní potřeby místo jejího prodeje. Aby syn uspěl, musel prokázat, že teta porušila své fiduciární povinnosti a že kvůli jejímu jednání utrpěl finanční ztrátu.

Expert svědek Charles Ranson měl vyčíslit, jaké škody vznikly tím, že teta nemovitost neprodala dříve. Avšak Ranson, který neměl žádnou zkušenost s oceňováním nemovitostí, se rozhodl použít Microsoft Copilot k provedení výpočtů.

Nespolehlivost AI v praxi

Soudce Jonathan Schopf vyjádřil vážné pochybnosti nad použitím AI při tak citlivém úkolu, jako je stanovení škod. Podle jeho názoru svědek neměl dostatečné odborné znalosti a spoléhal se na Copilot, který není nástrojem vytvořeným pro právní či finanční výpočty. Schopf dokonce osobně vyzkoušel generovat podobné výsledky pomocí Copilot, ale pokaždé obdržel různé odpovědi. To jen potvrdilo jeho podezření o nespolehlivosti nástroje v tomto kontextu.

Zdroj: Shutterstock

Jedním z hlavních problémů, které soudce vyzdvihl, byla skutečnost, že Copilot při odpovědi na otázku o své vlastní spolehlivosti uvedl, že jeho přesnost závisí na zdrojích a že by měl být vždy ověřen odborníky. Copilot také doporučil, aby byly výpočty potvrzeny profesionály, než budou použity v soudním řízení. To svědčilo o tom, že i samotný nástroj si uvědomuje své limity.

Etická otázka použití AI v právních řízeních

Jedním z největších problémů, které tento případ vyvolal, je otázka, jaká pravidla by měla platit pro použití umělé inteligence v právních procesech. Soudce Schopf naznačil, že by mělo být povinné předem informovat o tom, že bude AI použita při přípravě svědectví či důkazů. Podle něj by nekontrolované používání AI mohlo způsobit narušení právního systému, zejména pokud by svědci začali přehnaně spoléhat na výsledky generované AI.

Použití AI v právních řízeních otevírá důležitou otázku důvěryhodnosti. Jak upozornil právní expert Eric Goldman, smyslem svědecké výpovědi je především to, aby svědek poskytoval informace na základě své odbornosti a zkušeností. Pokud svědek pouze outsourcuje výpočty AI, ztrácí se smysl jeho odborné výpovědi. Právníci by v tomto případě mohli sami požádat AI o výpočet, aniž by platili drahé odborníky.